촉감 및 강체 피드백을 포함한 저비용 메타버스 인터페이스

Metaverse Interface with Haptic and Rigid Sense Feedback at a Low Cost

Article information

Abstract

메타버스 시대에는 누구나 쉽게 메타버스에 접근할 수 있어야 하고, 실감나게 가상 현실을 즐길 수 있는 기회를 제공할 수 있어야 하기 때문에 저렴한 가격으로 구현될 수 있는 메타버스 인터페이스 프로토타입을 제안한다. 크게 4가지 성능 및 모듈이 포함된 형태의 작품으로, 1. Haptic feedback: piezo 센서는 다양한 texture의 촉각 정보를 수집하는데 사용되고, 이는 오디오 데이터 형태로 전송하여 장갑에 부착된 LRA 모터(Actuator)에 의해 손끝에서 현실적인 촉각 정보를 재현한다. 2. Force feedback: 3D 모델링을 통해 서보모터를 제어하도록 설계되었다. 게임 엔진인 유니티에서 물체의 두께만큼 손을 잡도록 서보모터를 제어한다. 3. Controller: flex 센서를 사용하여 finger bending에 따른 저항 변화를 측정하여 유니티에서 손가락 동작을 재현한다. MPU-6050(IMU sensor)를 이용하여 유니티에서 yawing/pitching/rolling 동작을 구현한다. 4. Pose estimation: 웹캠에 의해 사용자의 현재 움직임은 mediapipe library를 통한 포즈 추정에 사용된다. Controller로부터 serial로 수신된 손 자세와 통합되어 유니티 게임 내에서 사용자의 자세를 구현한다. 이러한 방식으로 개발된 인터페이스는 메타버스에서 life logging과 mirror world 서비스에 적용될 수 있다.

Trans Abstract

In the metaverse era, anyone should be able to easily access the metaverse for non-discrimination. This study proposes a prototype of a metaverse interface that can be implemented at a low price. It shows reasonable performance. It includes the following 4 modules. 1. Haptic feedback: Piezo sensors have been used for tactile information of various textures, which is transported as an audio data format, and reconstructed at the fingertips by an actuator (LRA motor) attached to a glove. 2. Force feedback: The module was designed to control the servomotor through 3D modeling. It provides force feedback by controlling the servo motor to grab the hand as much as the thickness of the object on Unity, the game engine. 3. Controller: Reproduce finger movement in Unity by measuring resistance change according to finger bending using a Flex sensor. Implement Yawing/Pitching/Rolling movement in Unity through MPU-6050(IMU) sensor. 4. Pose estimation: The user's current movement captured by the webcam is used for pose estimation through the Mediapipe library. It is integrated with the hand posture received serially from the controller to render the user posture inside the Unity game. The developed interface can be applied to life logging service and mirror world service, which are one of the most important applications in the metaverse.

Introduction

이 연구는 현실감 있는 메타버스 인터페이스를 많은 사람이 쉽게 접근할 수 있도록 하는 것을 목표로 한다. 기존의 VR등의 메타버스 시스템은 실감성을 높이기 위해 주로 시청각적 자극에 집중하고 있다. 이러한 접근 방식은 값비싼 고주사율 고해상도의 디스플레이나 높은 수준의 렌더링을 요구한다. 이러한 방식은 부수적으로 이러한 매체를 자주 접하지 않은 사람들에게 멀미와 같은 부작용을 유발한다(Geršak, Gregor et al., 2018). 이런 접근 방식은 시각적 반응성이 중요하기 때문에 움직임을 빠르고 정확하게 추적하기 위해서 적외선 마커나 다중의 카메라를 사용하는 방식을 이용하는데, 이 또한 비용 상승의 원인이 된다.

현실에서는 표면의 다양한 물체와 접촉하거나 마찰할 때 특정한 진동이 발생한다. (Guruswamy V. L. et al., 2011) 또한 물체를 잡으면 강체에 의한 반발력이 느껴진다. 이러한 관점에서 기존의 사용 제품들은 변동성 없는 컨트롤러를 사용하며 Eccentric Rotating Mass (ERM)를 통해 제한적으로 사용자에게 피드백을 제공한다.

따라서 본 연구에서는 실감성을 더하고 비용을 줄여 보다 많은 사람들이 쉽게 메타버스를 접할 수 있도록 촉각에 집중하는 새로운 방식을 설계하였다. 앞서 살펴본 1. 높은 비용의 장치들 2. 부족한 촉각적 경험에 집중하여 대안적인 메타버스 인터페이스를 제안한다.

Materials and Experimental Method

메타버스는 그 개념의 범위가 아주 넓기 때문에 다양한 적용 분야를 가지고 있다. 가장 사용자에게 익숙한 예시는 오락분야로 많이 적용된 VR 장치일 것이다. 하지만 이러한 장치들은 아주 민감한 감각인 시각에 집중하고 있기 때문에, 만족시켜야 하는 수준이 상당히 높으며 이는 자연스레 높은 가격으로 이어진다. 하지만 메타버스의 적용 범위가 교육 등으로 넓어지는 가운데 (Hae-Chan Na et al., 2022) 이러한 비용문제는 진입장벽이 되고 있다. 이에 대한 대안으로서 민감한 시각에 대한 의존을 낮추고 촉각 기능을 추가하여 이러한 문제를 보완하는 장치를 설계하였다. 이를 위해 다음의 4가지 모듈로 구성되는 장치를 설계하였다.

1. Haptic Feedback

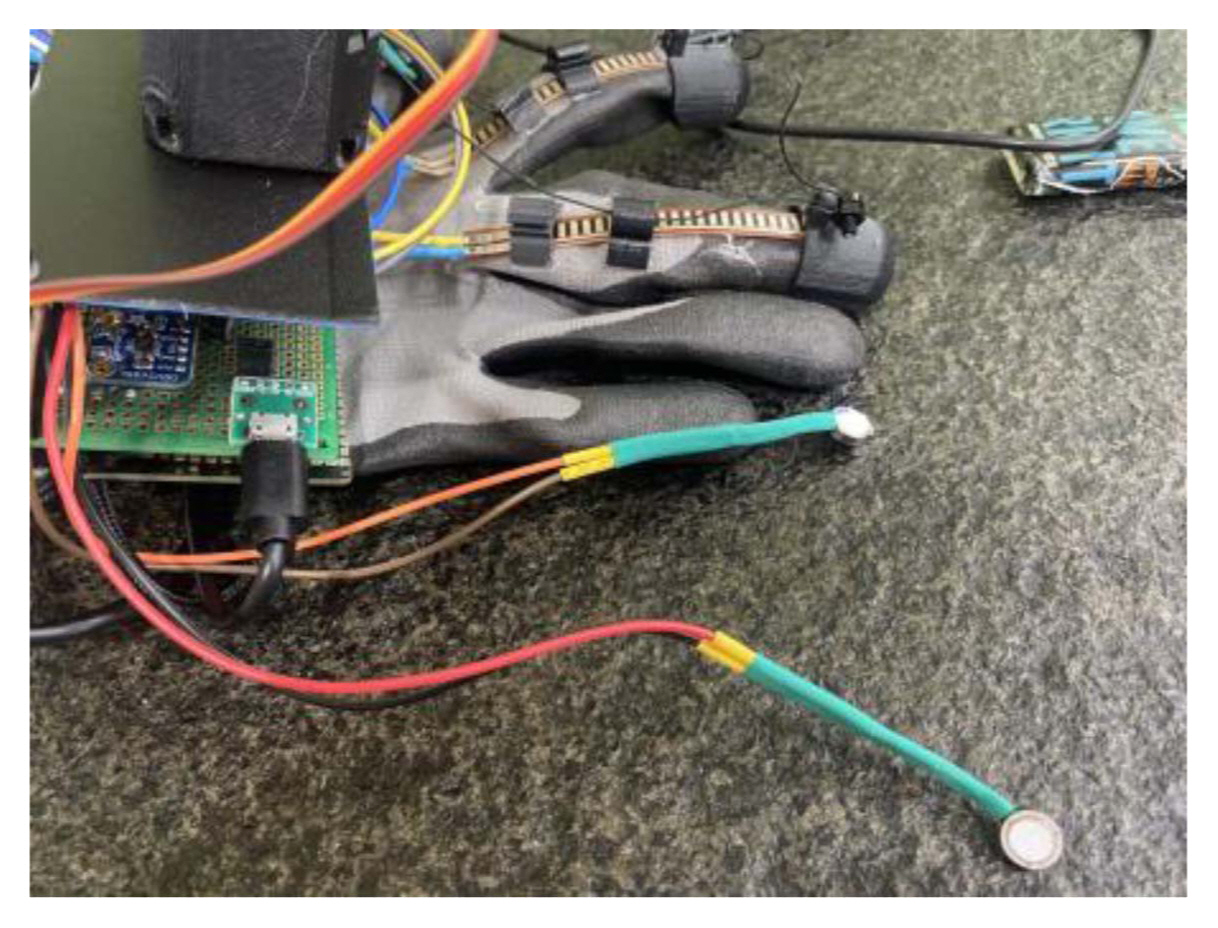

이 모듈은 사용자에게 촉감경험을 제공한다. 여러가지 재질을 가상 세계에서 구분하기 위해, 현실에서 표면 특성을 획득할 필요가 있었다(Ultraleap Co. Ltd., 2019). 이 과정을 단순화하기 위해(Grigore C. Burdea, 1999) 일정한 압력과 속도 하에서 압전소자를 마찰하여 표면의 요철을 전압으로 매핑하였다.

촉감 재현을 위해서 많은 소자가 고려되었다. 압전소자를 이용하는 경우에는 높은 Dynamic Range와 반응속도를 얻을 수 있지만, 발생하는 진동이 너무 작았다(조영돈, 2002). 기존에 많이 사용되는 Eccentric Rotating Mass (ERM) (손정우, 2012) 소자는 매우 느린 반응속도와 매우 좁은 Dynamic Range를 가지고, 회전하는 모터를 사용하는 특성상 다양한 주파수를 재현하기 곤란하다. 따라서 이 두 가지 특성에서 적절한 성능을 가지는 Linear Resonance Actuator (LRA)를 촉감 재현 소자로 적용하였다.

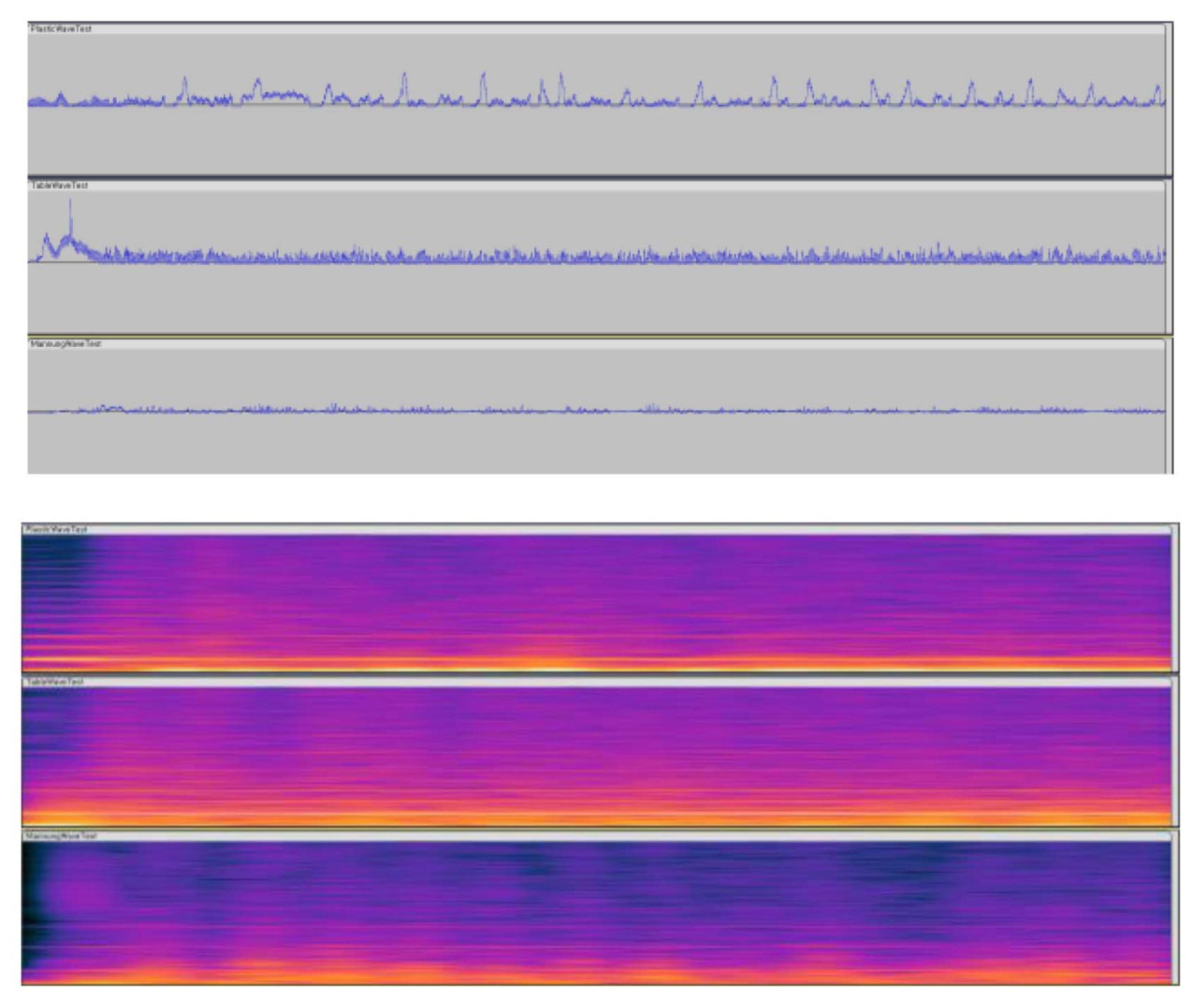

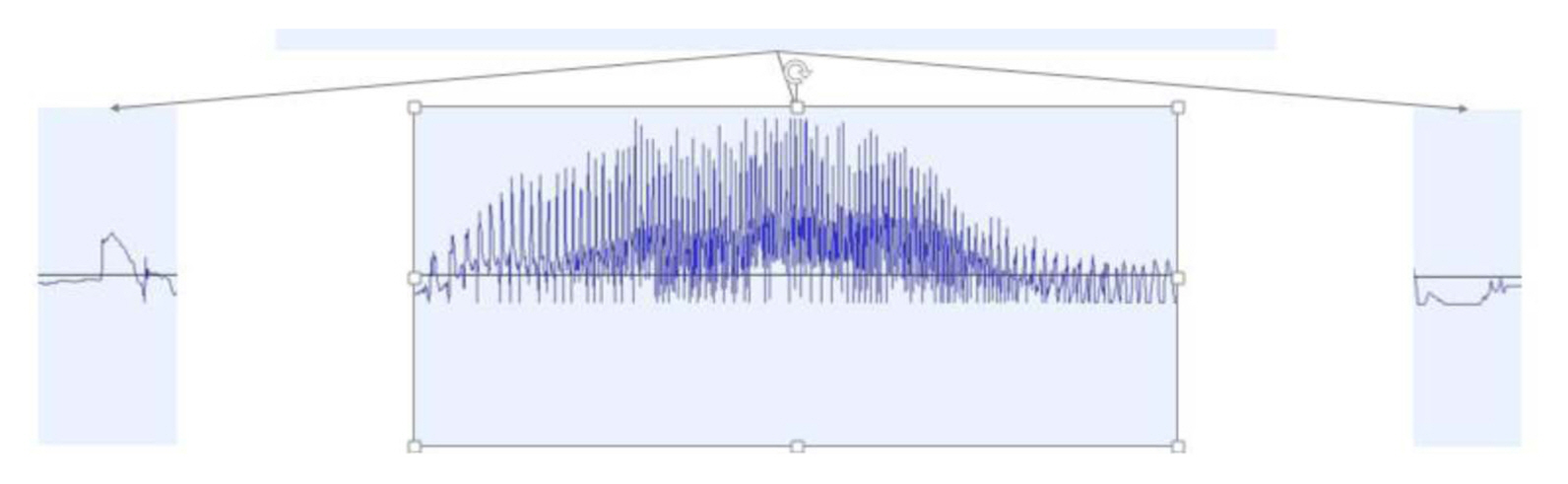

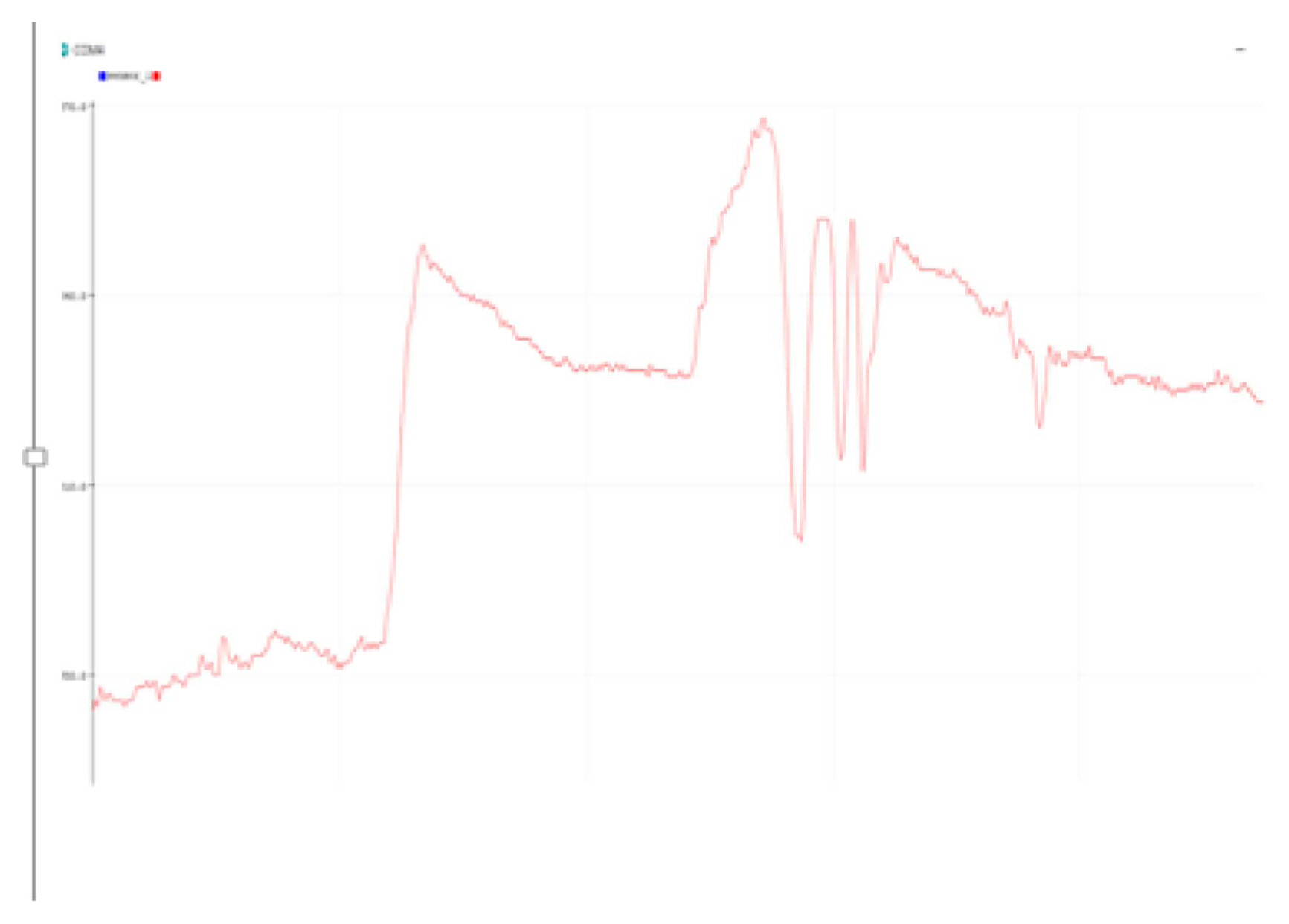

수집된 촉각 데이터를 고속 푸리에 변환 (FFT)를 통해 분석하려 하였으나, Figure 1에서 보는 바와 같이 표면 요철의 불규칙성으로 인해 주파수 특성을 분리하기 어렵다. 주파수 특성이 복잡하게 중첩되어, 아두이노 상의 FFT 및 재현에 한계가 존재하였다. LRA의 Dynamic Range와 반응속도가 충분하기 때문에 표면의 불규칙성을 그대로 WAV형식의 음성 신호로 입력할 수 있었다. WAV형식을 사용함으로써, 다른 method에 비해 압전소자의 DC 오프셋을 제거하거나, LRA의 공진주파수(약 240 Hz)에 대한 대역차단필터 적용이 용이한 장점이 있었다. 또한, 마찰 속도와 압력에 의해 변하는 촉감을 피치 등의 음향특성으로 보다 쉽게 제어할 수 있다는 부수적인 이점이 있다. 따라서 Material의 표면 거칠기를 piezo 센서로 직접 측정한 spectrogram의 haptic data를 wav형태로 직접 저장하여 더욱 실감적으로 feedback이 가능하게 된다. 또한 haptic driver로 사용한 DRV2605L audio line을 활용하여 간편하게 wav형태를 LRA motor로 출력할 수 있다. 이 데이터에서 인간의 촉각 과정을 접촉, 마찰, 분리의 세 부분으로 분할하여 적용하였다.

2. Force Feedback

촉감을 구성하는 요소에는 촉각적 자극뿐 만 아니라 물체가 주는 반작용 힘이 존재한다. 이는 기계적인 압력처럼 사람의 손에 어떠한 힘이 가해지는 방식이다. 현재 대부분의 VR제품들은 버튼이나 조이스틱 등으로 제한적인 방식을 사용한다. 또한 앞선 방식의 하드웨어가 없다면 허공에서 공기 저항밖에 반발력을 줄 수단이 없다. 따라서 우리는 Force feedback을 통해 위와 같은 문제점을 해결하고자 한다.

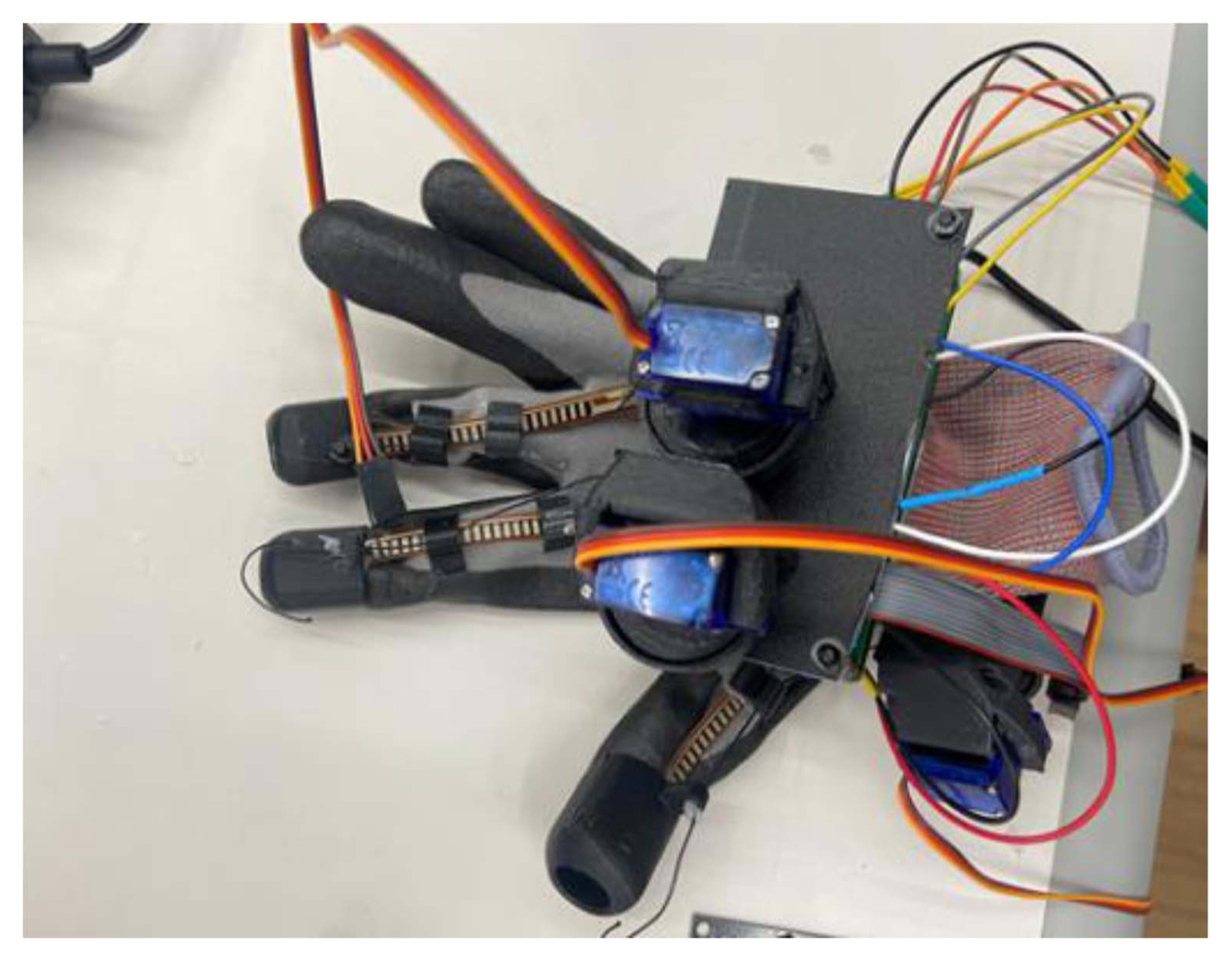

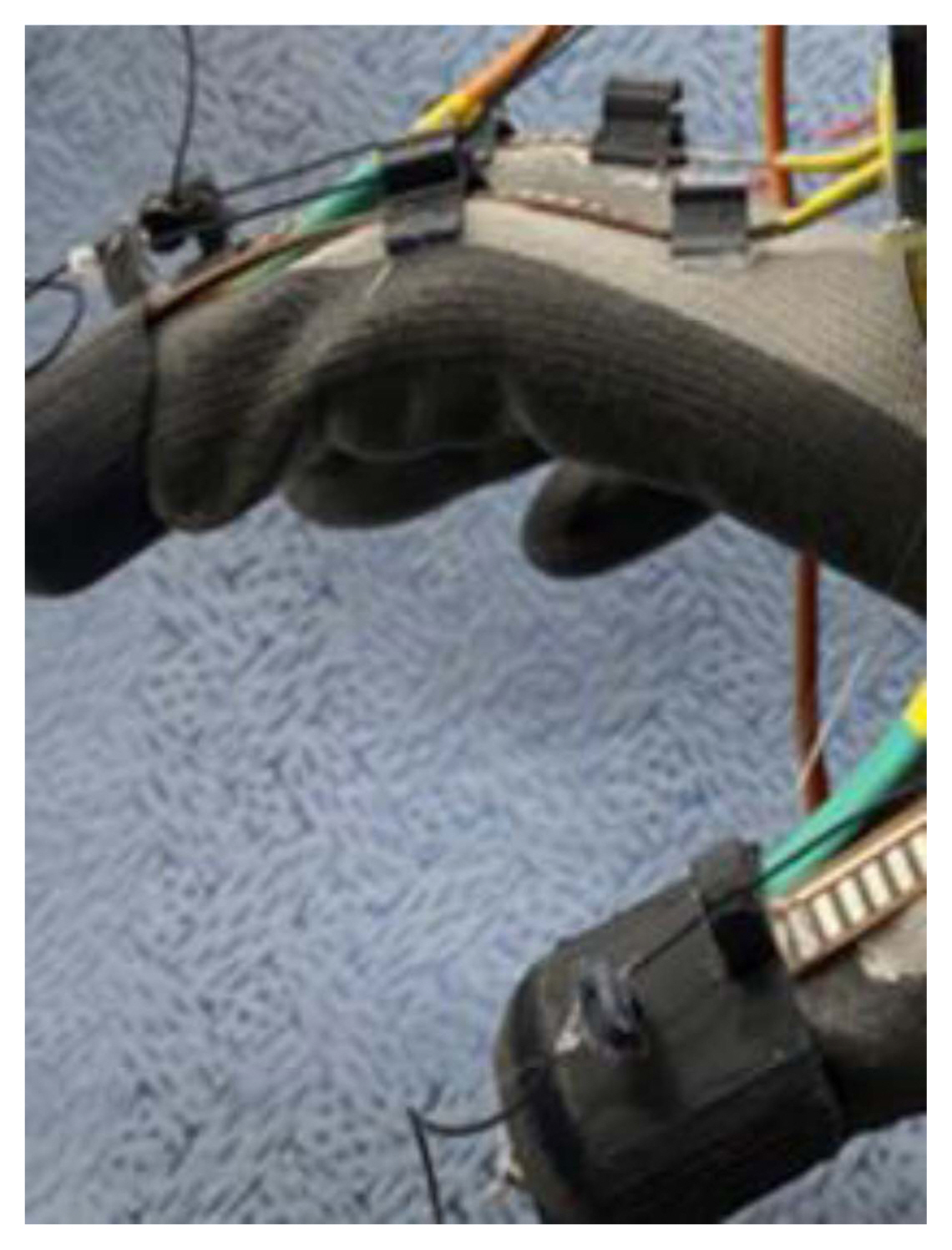

이를 위해 오픈소스 모델 (LucidVR, 2021)을 Blender로 우리의 목적에 맞게 수정하고 3D printer를 이용해서 조립했다. 이 모델은 장갑에 force feedback을 추가하여 실감형 VR 인터페이스를 구축했는데, pose estimation과 haptic 부분에서 본 논문과 차별성을 두고 있다. 또한 이들은 oculus의 Hand tracker 장치를 직접 부착하여 결국 어떠한 VR기계를 소비자가 구매한 뒤 추가로 또 장치를 사용해야하는 방식이라 불편함이 존재한다. 우리는 이러한 모델에서 force feedback 부분을 참고했다. 그 방식은 다음과 같다.

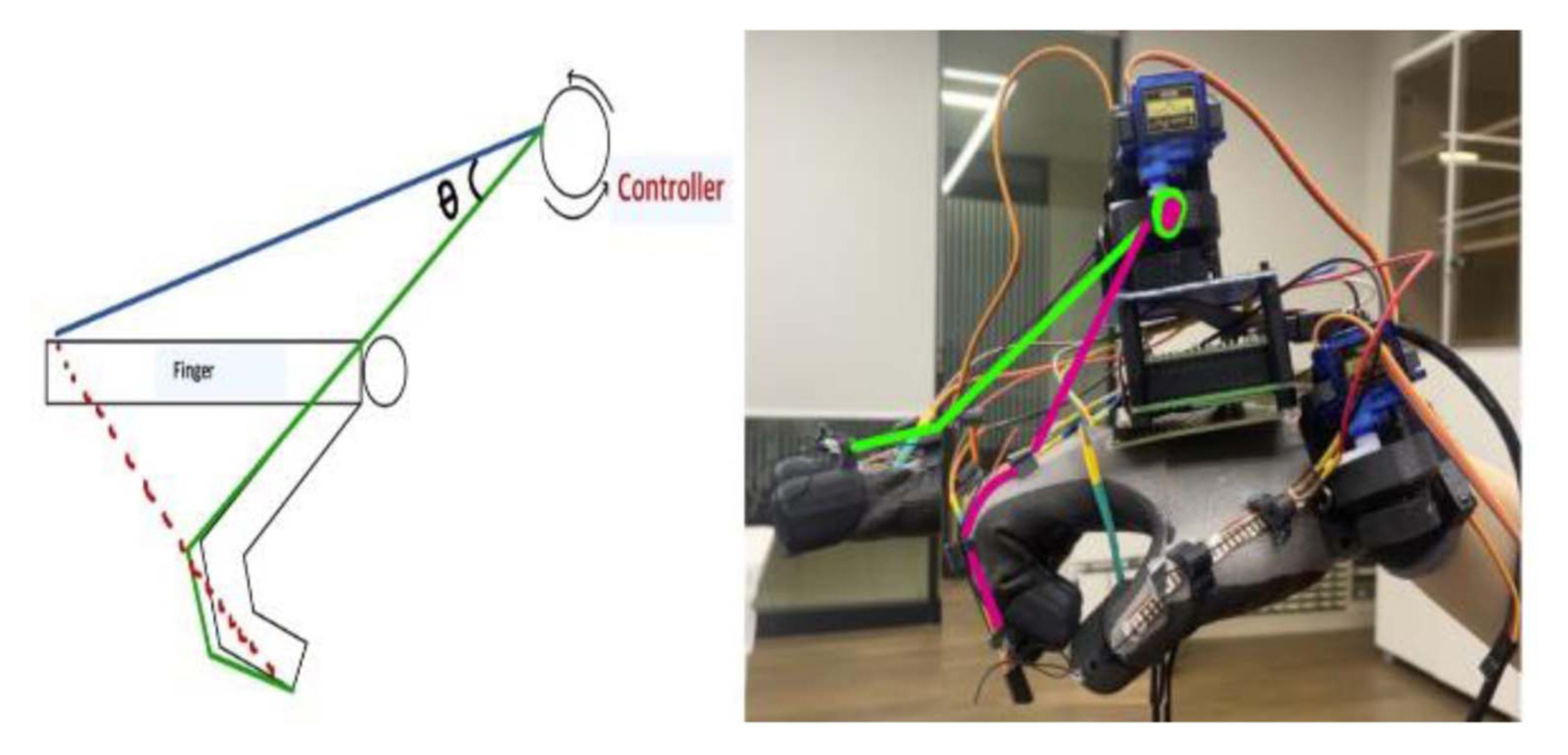

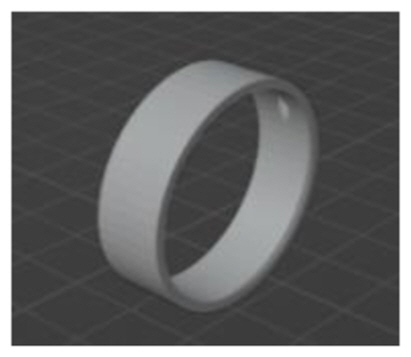

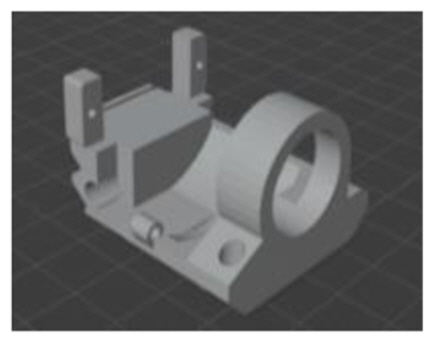

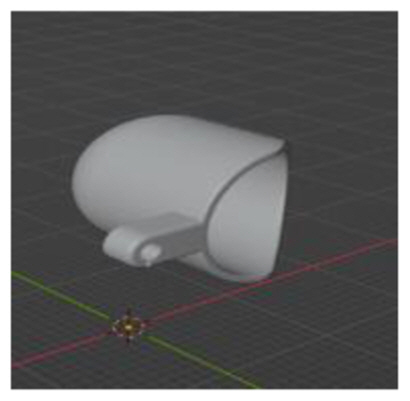

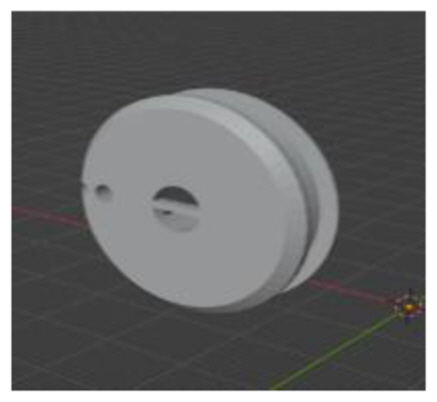

복원력이 있는 Badge reel과 와이어의 장력, 서보모터를 통해 손가락의 작동 범위를 제한했다. 장치는 Table 1에 소개된 Badge reel을 구성하는 Cover ring, Spooler, Tensioner와 와이어나 Badge reel과 연결되어 기계적으로 제한을 가하는 Finger cap, Node, Holder로 구성된다. Badge reel은 손의 움직임에 따라 감겨 있는 와이어의 길이를 스프링으로 조절한다. 이때, 구동을 담당하는 Spooler에 연결된 Bolt를 서보모터가 고정함으로써 기계적인 움직임을 제한하게 된다.

서보모터는 메인보드에 서보모터 모듈(AM-CSV)를 이용하여 3개를 연결했고(이는 필요에 의해 손가락 당 1개까지 연결 가능하다) 아두이노에서 어떠한 물체와 상호작용할 때 그 크기에 맞춰 각도를 제한하도록 서보모터를 제어했다. 이를 통해 실의 장력이 특정 지점에서 고정되고 사람은 이로 인해 반작용을 느낄 수 있다.

제한 메커니즘과 손가락의 움직임을 고려하였을 때, 손가락과 구동부의 각도에 따라 그 효과가 달라짐을 알 수 있었다. Figure 4와 같은 형태에서 각도가 클수록, 제한하는 방향과 힘의 방향이 같아져 효과가 좋아졌다. 따라서 각도(세타)를 높이기 위해 메인보드에 구조물을 덧대어 층을 높여 장착했다. 이를 통해 전보다 훨씬 더 좋은 반발력을 느낄 수 있었다.

인용논문에서 제안된 모델들은 실이 아닌 exoskeleton을 이용하여 force feedback을 구성했다. 이러한 모듈들은 감각 구현뿐 만 아니라 Force sensor와 Encoder (Em 3242) 등을 이용한 Force Record, Haptic등을 포함하고 있다. 또한 module자체가 하나의 M CU를 가지며 손가락당 여러 개의 encoder와 SG (strain gauge) 등 가짐에 따라 전력 소모, 모델 부피, 배선 등이 복잡해지는 단점이 있다. 하지만 본 제품은 간단한 실과 가벼운 3D부품을 통해 compact한 모듈을 구현했으며, 아두이노에서 받은 데이터를 통한 각도 하나로 조절할 수 있기 때문에 직관적이고 간단한 force feedback 방법이다.

본 Force Feedback은 prototype 상으로, 그 부피가 조금 크다. 아직 초기 개발 단계이고 목적에 필요한 시제품들로 구성했기 때문에 수직 방향으로 부피가 커졌다. 부품들을 간소화 시키고, servo motor의 크기를 줄인다면 훨씬 더 적은 부피를 가질 수 있을 것이다. 그리고 만약 각도를 제한하는 축의 반지름이 더 커질 수 있다면 물체 구분의 분해능은 더 좋아질 것이다. 또한 저렴한 블루투스 모듈을 이용하고 전선들을 짧게 한다면 지금 보다 더 compact한 모델이 될 수 있을 것이다(Pinhas Ben-Tzvi & Zhou Ma, 2015).

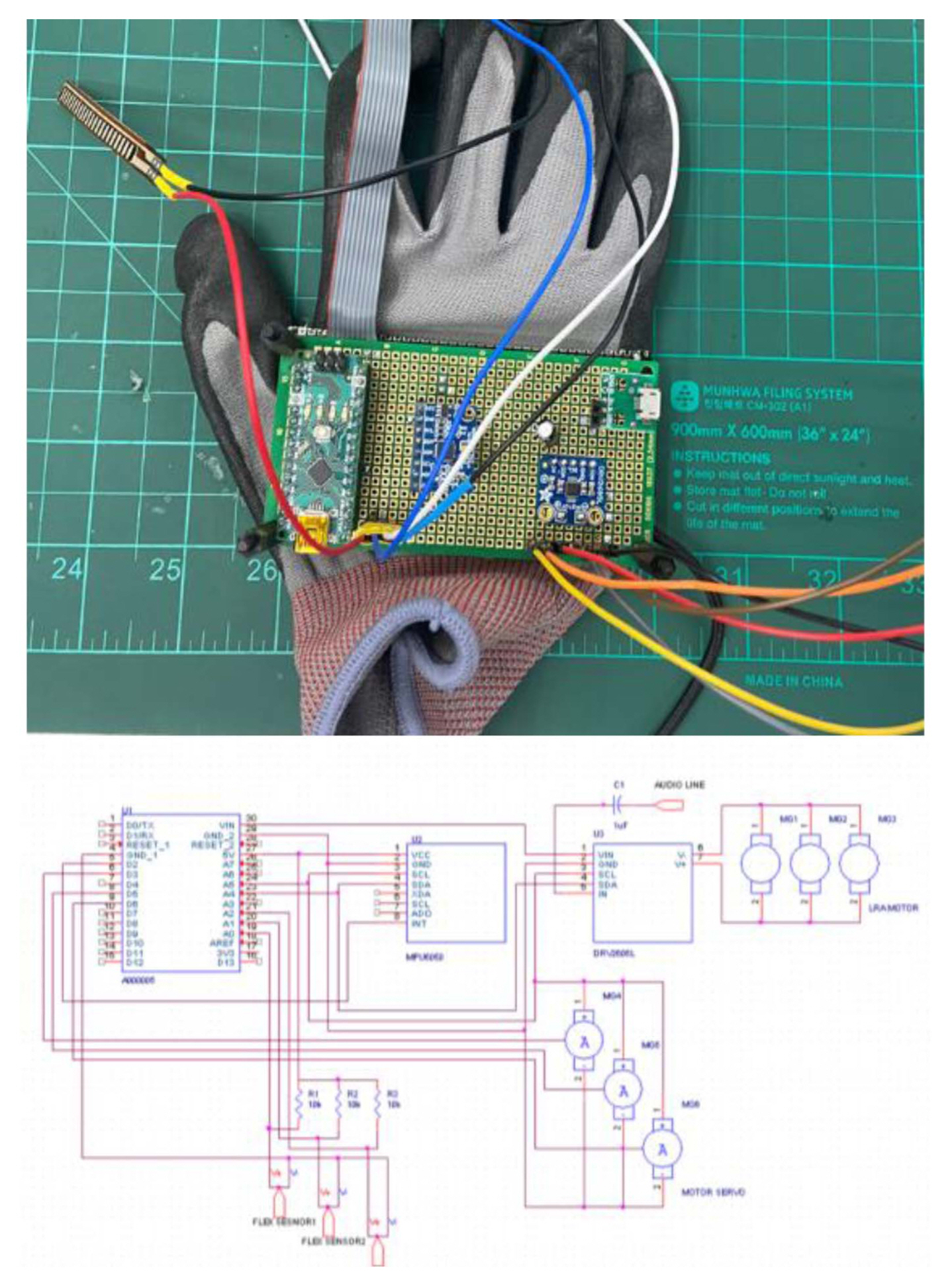

3. Controller

낮은 가격과 쉬운 활용성을 고려하여 시제품 설계에서는 Arduino 보드를 micro controller unit (MCU)으로 사용하였다. 전체 구성은 Figure 5에서 제시된 바와 같다. Controller 단에서는 각각의 feedback을 제어하고, 손의 현재 상태 운동 상태를 측정해야 한다. 이를 위해 휘어짐을 인식하는 flex sensor와 관성 측정 모듈인 MPU-6050, 마지막으로 시리얼 통신으로 정보를 주고받는 소프트웨어로 구성하였다.

구부림과 압력 두가지 요소에 영향을 받는 SZH-SEN02 센서가 아닌 오직 구부림에만 영향을 받는 SEN-10264 센서를 사용하여 정확한 손가락 굽힘 구현이 가능하다. 이 Flex sensor의 휘어짐의 정도에 따라 저항 값이 달라지는 성질을 이용해 고정 저항과의 전압 분배를 이용하여 손가락의 굽힘을 인식할 수 있다. 780~870범위에서 Flex sensor의 출력값이 구부릴수록 커지는 것을 확인할 수 있었다(Figure 6).

또한 MPU-6050은 Arduino와 I2C 버스로 통신하여 가속도와 각속도 정보를 제공한다. 이 값들의 오프셋 제거, 두 데이터의 상호 보완적인 Filter 연산을 통해 Figure 7와 같이 손의 Yawing, Pitching, Rolling의 Euler Angle 정보를 얻을 수 있다.

가상 환경에게 이렇게 획득한 정보를 보내고, 또 피드백 정보를 수신하기 위해서 양방향 시리얼 통신을 사용하였다. 중간에 바이너리 손실로 인한 비동기화 문제를 해결하기 위해 송수신 시작에 마커를 삽입하였다. 이 Software 마커를 기준으로 데이터를 동기화하여 오류를 크게 감소할 수 있었다.

이렇게 수신한 제어정보를 통해 서보모터를 제어하여 적절한 피드백을 제공하였다. 또 하나의 제어신호인 Haptic Feedback의 경우에는 AUX케이블을 통해 음성 신호로 주어지기 때문에, Arduino에서는 LRA를 오디오 입력으로 세팅하는 역할만을 수행하였다.

4. Pose Estimation

실제 세상의 인간의 움직임을 추적하기 위해서는 Controller에서 수집된 손가락 움직임과 손의 Euler 각으로는 부족하다. 3차원 공간에서의 인간의 움직임을 추적하기 위해, 우선 2D Pose Estimation 모델인 “Openpose” (Zhe Cao et al., 2018)를 3D Pose Estimation으로 전이학습을 시도하였다. 이 과정에서 3D pose Dataset mpi_inf_3dhp (Chen Tianlang et al., 2022)을 배경 합성 등의 방법으로 데이터 증강하여 적용하려 하였다. 하지만 개인용 PC에서 이러한 규모의 학습을 진행하기에는 무리가 있었다. 개발 환경에서 48시간동안 약 72,000장이 학습되었는데, 기존 모델 들에서는 수십만 Epoch를 학습하기 때문에 현실적으로 학습이 어려웠으며, 이렇게 학습된 모델은 낮은 사양의 환경에서 구동 가능하지도 않을 것이다.

따라서 google 이 개발한 open-source model인 “Mediapipe” (Google LLC, 2020)를 사용하였다. 해당 모델은, 3D 좌표를 단일 카메라로 실시간 추정하며, TensorFlow Lite (Google LLC, 2020) 기반으로 구동되어 낮은 사양에서도 구동 가능해야 하는 목적에 부합하였다. 개발 시간의 단축 및 효율 또한 자연스럽게 따라왔다. 다만 Single Camera 기반으로 3D 좌표를 추정하는 특성상 자세는 잘 추정되었으나, Z축 좌표의 정확도에 한계가 있었다. 인게임에서 Z축 방향으로의 움직임을 4단계의 낮은 Resolution으로 분할하여 적용하였다. 깊이 방향의 실제 움직임을 다소 제한하지만, 평면 디스플레이를 사용하는 시스템의 특성상 불편은 최소화하면서 Z 좌표 부정확성에 의한 문제를 회피할 수 있었다.

Python상에서의 Multi-threading을 통해 Listener와 Responder, Data Processor를 동시에 실행하도록 구현하였다. Data Processor는 Figure 11에서와 같이 실시간으로 Mediapipe를 통해 위와 같은 좌표정보를 획득하고, JSON String으로 변환한다. 이를 Socket 통신을 통해 Localhost를 Listen하는 Listener가, 정상적인 Request가 있을 때, Responder thread를 생성하여미리준비된 JSON String을 Socket으로송신한다. 이 방식은 Localhost를 사용하였지만, Socket 통신의 설정을 통해 쉽게 Online으로 확장 가능하도록 설계하였다.

Results and Discussion

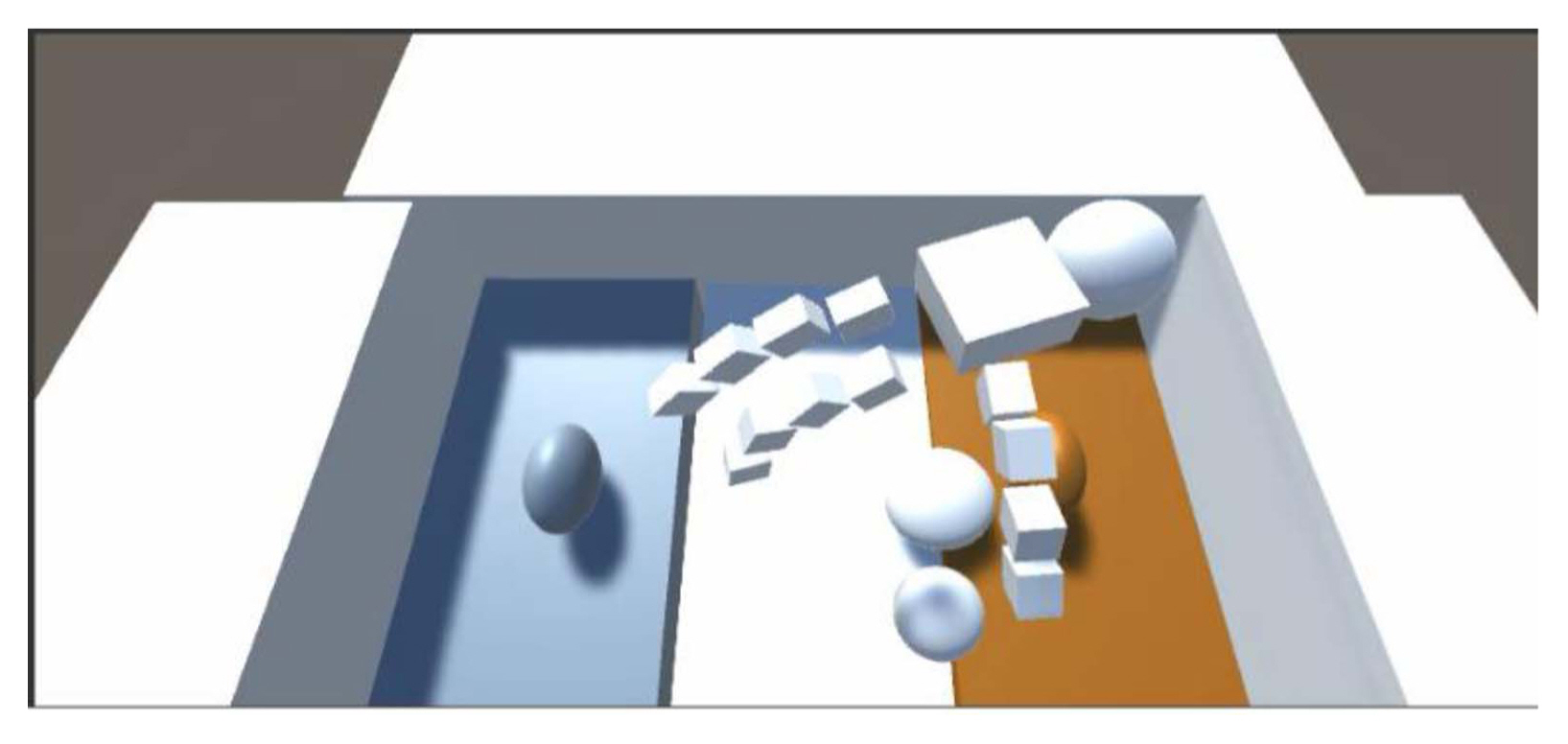

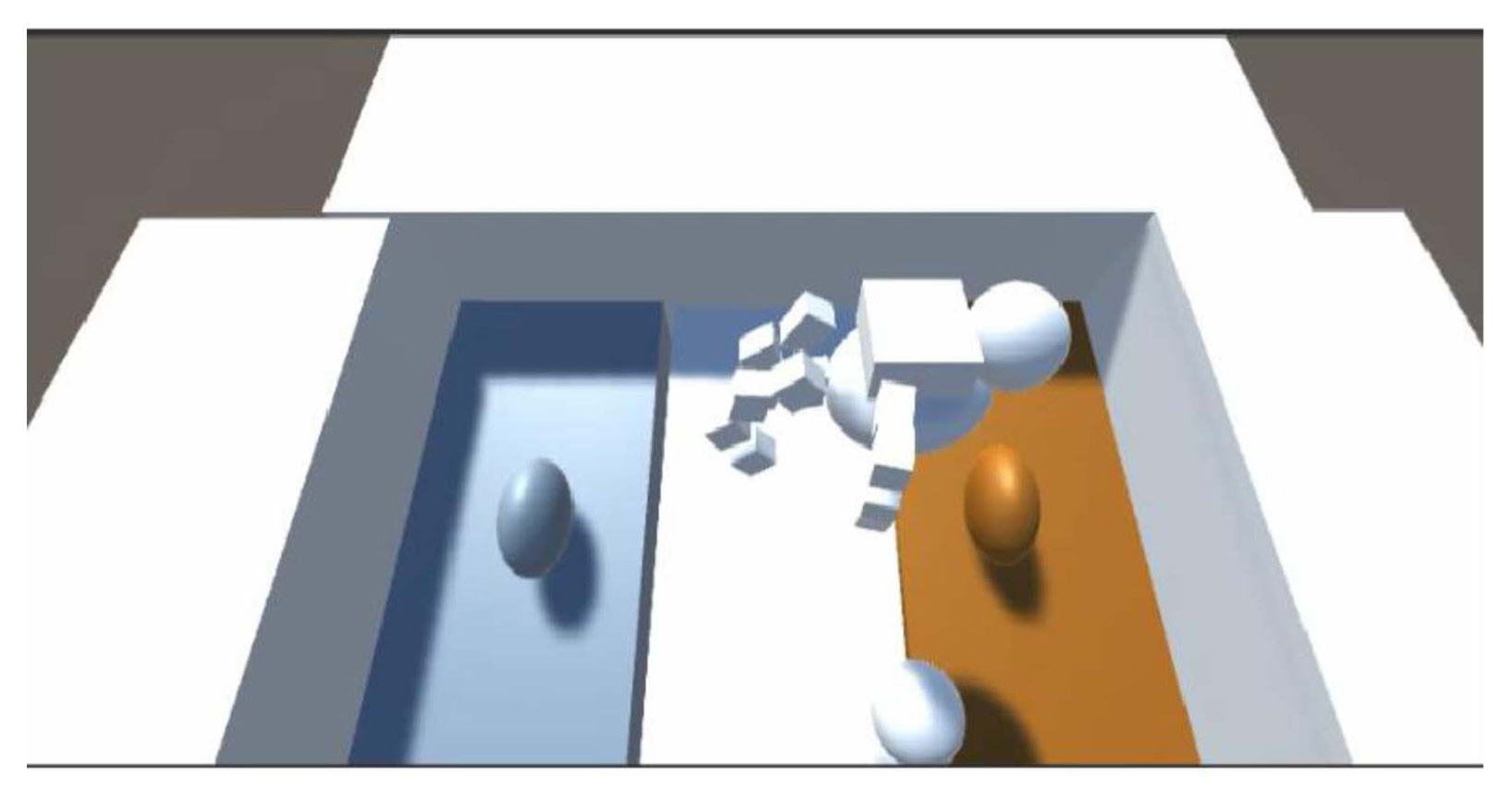

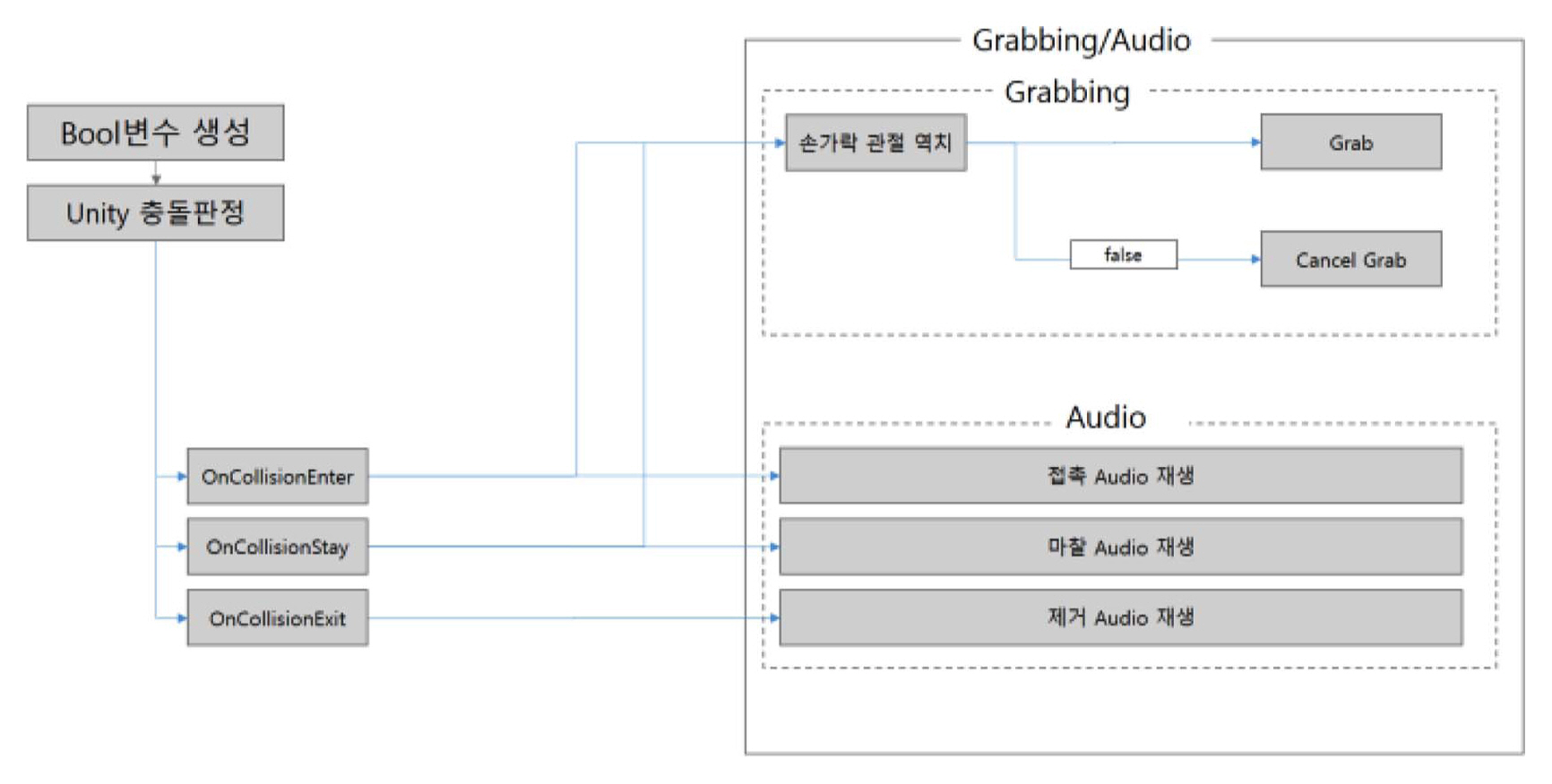

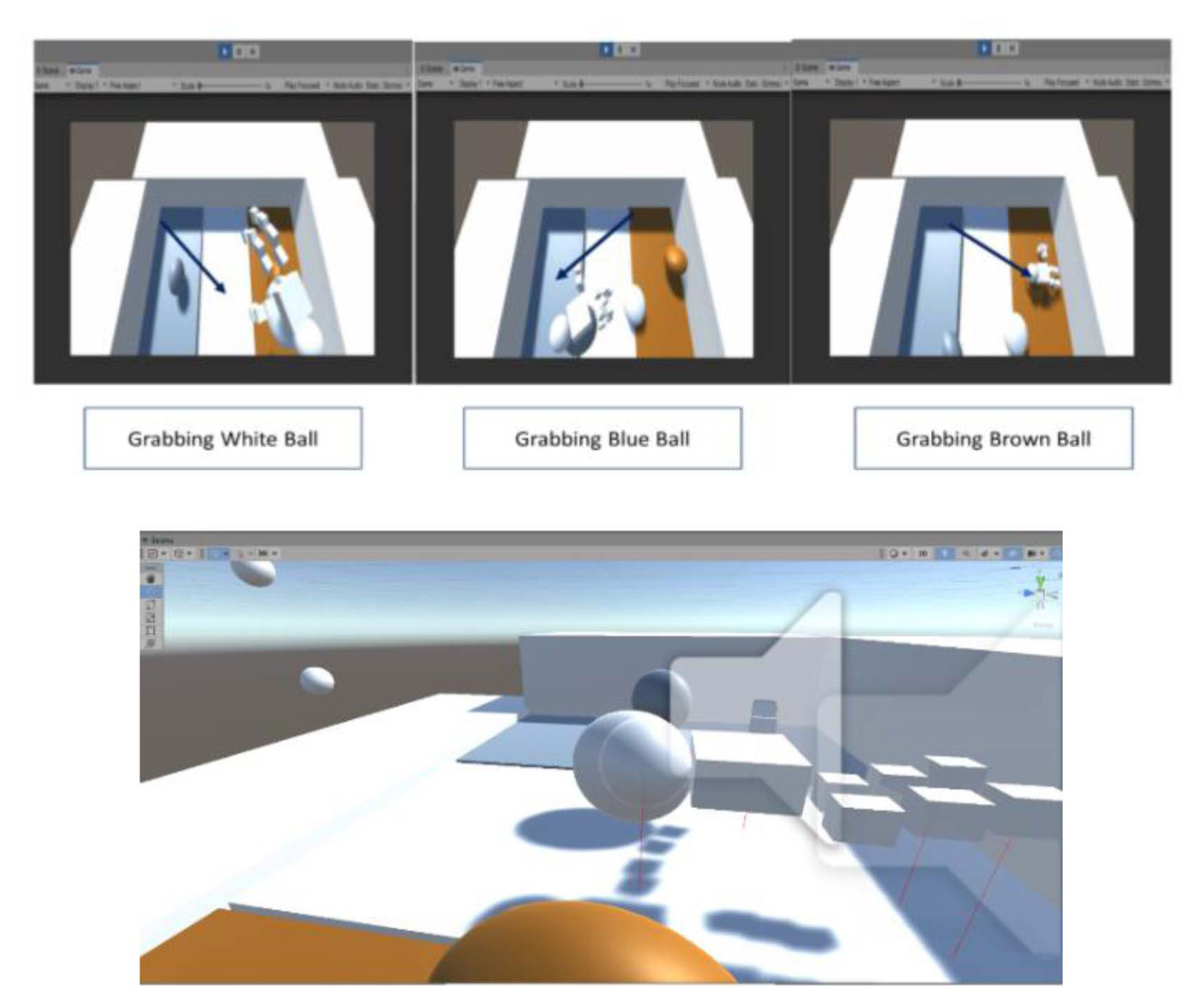

소개한 모듈들을 종합하기 위해서 Unity Engine에서 구동되는 예제 프로젝트를 설계하였다. 예제 프로젝트의 설계는 Figure 13의 논리 구조를 가지는 가상 공간상의 고정되거나 움직일 수 있는 물체와 상호작용하는 간단한 게임이다. 낮은 비용과 저사양 환경에서의 작동성을 확보하기 위해 예제 프로젝트에서 VR을 사용하지는 않았지만, 필요시에 쉽게 확장 가능하다.

가장 먼저 모듈의 Serial과 Socket 두 가지의 interface와 통신하는 Interface를 구성하였다. 가상 환경에서, interface에서 받은 정보를 바탕으로 손의 움직임을 재현한다. 이 손이 물체에 접촉하면, 물체의 특성과 위치, 속도 등에 따라 haptic, force feedback을 게임 환경이 계산하여 interface로 전송하여 feedback 체계를 작동시킨다.

이동 가능한 물체의 경우에는 손을 펼치기 전까지 해당 물체는 손과 함께 이동한다. 이 과정을 “Grabbing”으로 정의하였다. 이때는 접촉과 분리의 촉각 신호가 각각 재생된다. 또한고정된물체와 사이에서는마찰이지속 발생하며, 이를 “Rubbing”으로 정의하였다. 이 경우에는 마찰 상태에 따라 적절하게 변조된 마찰 신호를 재생한다. 이런 상태를 구분하기 위해 Figure 14에서 보이는 바와 같이 Unity의 “RayCast”기능을 사용하였다.

하지만 몇 가지 한계가 존재한다. 주로 비용과 성능 사이의 Trade off로 인한 한계들로, 추후 개선이나 생산 비용 절감 등으로 해결 가능할 것으로 보인다.

Haptic feedback에서는 아두이노에서 생성한 piezo texture data를 PC에서 받아 WAV 형식으로 저장한 후 Actuator(LRA motor)로 전송하여 보다 더 실제 texture와 유사한 feedback을 제공할 수 있다.

본 연구에서는 접촉 속도 v와 인체의 물성 Eskin이 영향을 준다는 점을 고려하여 이러한 가정의 감각 모델에 따라 접촉속도에 따라 피치를 조절하였다. 하지만 입력장치의 물성으로 인한 주파수 응답 HEpiezo와 LRA 주파수 응답 특성 H*LRA에 의해 사용자에게 제공되는 Haptic Feedback S에는 실제 인간의 감각 체계 Shuman과는 달라지는 왜곡이 발생한다.

이 때문에 LRA 모터의 공진주파수에 대역제한필터를 적용하여 HEpiezo의 효과를 최소화하였으나, 그럼에도 공진주파수에서 강한 반응이 나타났다. 이로 인해 HEskin과는 차이가 발생하여, 주파수 응답을 완벽히 재현할 수는 없어 촉감에 변형이 발생할 수밖에 없었다.

Force feedback에서는 1.8 kgm/s의 토크로 손가락을 제어하는데 충분했으나, 고정된 방향의 하나의 와이어에 의존한 시스템에서 손가락이 의도치 않은 방향으로 움직이는 현상이 있었다. 서보모터의 제한적인 작동범위 해상도 또한 다른 제어문제를 발생시킨다. 또한 Badge reel은 항상 스프링으로 인해 복원력을 가지므로, 물체를 직접 잡지 않을 때도 실 자체의 장력으로 인해 Figure 15와 같이 아주 작은 tension이 느껴질 수 있는 차이가 있다

Pose estimation에서 단일 카메라 방식은 저비용, 저사양의 목적에 부합하지만, 낮은 framerate와 부정확한 깊이 추정으로 인한 부자연스러운 자세가 문제가 되었다. 이를 해결하기 위해 추가적인 보간이 필요했으며, Z축 방향 Depth의 움직임을 제한하여 구현하였다. “Openpose” (Zhe Cao et al., 2018)와 같은 2D Pose Estimation 모델을 3D pose Dataset mpi_inf_3dhp (Chen Tianlang et al., 2022) 도메인으로 3D Pose Estimation 전이학습이 고려되었다. 하지만 PC에서 이러한 규모의 모델은 현실적으로 학습과 실행이 어려웠으며, 따라서 실제 낮은 사양의 환경에서 구동 불가능할 것으로 판단하여 배제되었다. 이외에도 상용 제품에 쓰이는 적외선 방식이나 Multi camera 솔루션을 적용한 더 정확한 Tracking도 고려되었으나, 이 또한 비용 상승의 문제로 목적에 부합하지 않아 배제되었다

Conclusion

4가지 모듈을 통합함으로써, 촉감과 강체에 대한 피드백을 가진 메타버스 인터페이스를 구성할 수 있었다. 낮은 비용의 장치와 비교적 낮은 성능의 PC로 인해 부족한 현실성을 손가락의 움직임을 제한하고 촉각적 진동 신호를 통해 가상 세계에서의 상호작용을 전달하여 개선할 수 있었다.

또한, 본 연구는 사물과 사람에 대한 일상적인 경험 뿐 만아니라 다양한 사물에 대한 데이터를 재현할 수 있다는 점에서 사물과 사람에 대한 정보를 캡쳐 및 저장하여 공유하는 기술의 life logging과 현실 세계를 디지털로 그대로 재현한다는 할 수 있다는 점에서 Metaverse의 기능(S. Juhn et al., 2007) 중 Life Logging과 Mirror World의 개념을 함께 연결하였다. 실제 세계에서 정보를 저장하고 처리할 뿐만 아니라, 이 정보를 가상 세계에서 구현하고 현실 세계와 상호작용 가능하게 만들었다. 기존의 다양한 사물에 대한 정보(texture나 object 두께)를 가상 현실에 반영하여 일상생활에서 일어나는 순간들을 텍스트, 영상, 사운드와 같은 형태로 캡처하는 것에서 나아가, 그 내용을 서버에서 재생시키며 가상 세계에서의 경험을 다른 사람들과 공유함으로써 life logging 분야에 국한된 것이 아닌 융복합 형태로 virtual world와의 결합 형태로 발전할 수 있다. 뿐만 아니라, 이러한 복합 가상현실 장치는 뇌졸중환자 등의 기능 회복 재활 훈련에 효과적으로 사용될 수 있다. 2014년부터 2020년까지 꾸준히 증가하고 있는 환자들은 약 88%가 사회적 활동 수준 감소를 초래하는 상지기능 장애를 경험한다(김지훈, 2018; Kim Koun, 2019). 기존의 상지 로봇치료를 통하여 어느 정도 효과적인 재활치료를 수행 가능하지만, 상용화된 제품의 가격이 부담스럽거나 더욱 효과적인 재활이 필요한 경우에는 활용이 어려운 상황이다. 본 논문에서는 이를 해결하기 위하여 Haptic Feedback, Force Feedback, Controller, Pose Estimation 총 4가지의 성능 및 모듈로 구현한 작품을 다루고자 한다.

기존 상용화된 제품의 작동에 필요한 최소한의 자원만 사용해서 정상작동을 확인함으로 경제적 및 자원적 효율화를 달성하여 개발도상국가에서도 쉽게 접근 가능하고 Haptic Feedback 기능의 추가로 뇌졸중 후 기능적 감각 판별 능력을 크게 향상시킬 수 있다(Leeanne Carey et al., 2011). 하지만 장갑의 특성상 절단환자의 경우 사용이 어렵다는 한계점이 존재한다. 본 연구는 이러한 융합적인 메타버스의 기능을 실제 사용 가능하며 누구나 쉽게 접근 가능하도록 하는 데에 그 의의가 있다.

Acknowledgements

This work was supported by Institute of Information & communications Technology Planning & Evaluation (IITP) grant funded by the Korea government (MSIT) (No. 2022-0-00452).